Pulso IA #54 | El modelo que no saldrá al mundo

La publicación semanal de Amplify: claridad, estrategia y comunidad para ampliar tu ventaja con inteligencia artificial.

Claude Mythos.

Esta semana ha descubierto miles de vulnerabilidades en todos los principales sistemas operativos y navegadores del mundo.

Anthropic ha decidido no publicarlo. Porque funciona demasiado bien.

El resto de la semana: OpenAI publicó un documento proponiendo que los gobiernos graven con impuestos los robots que la propia compañía construye, Meta reapareció con un nuevo laboratorio y su primer modelo, y una encuesta reveló que la mitad de los consumidores preferiría comprar en marcas que no usan IA en su contenido.

No ha sido una semana tranquila.

Latidos de la semana

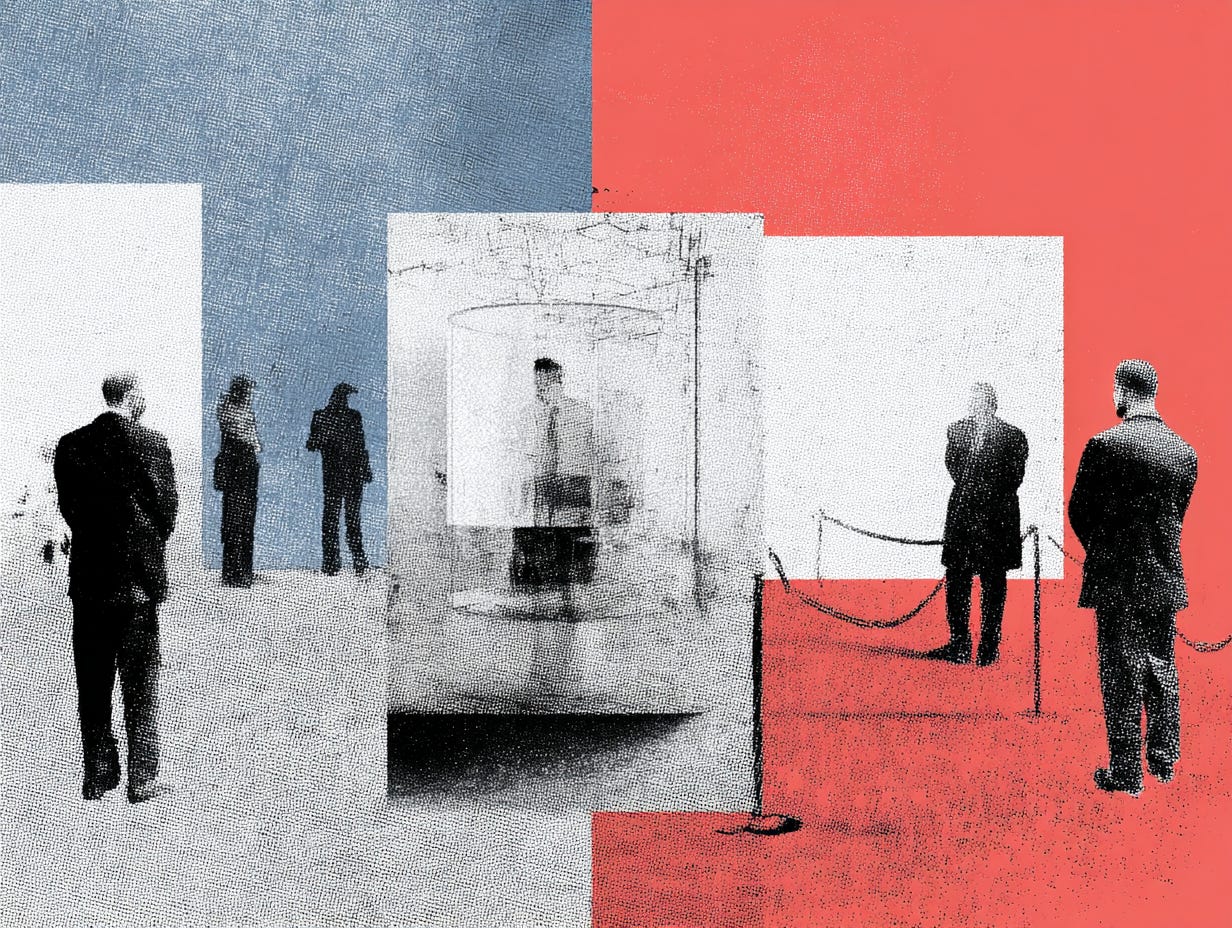

Anthropic construyó el modelo más peligroso de la historia y decidió no publicarlo

A principios de esta semana, Anthropic reveló públicamente los detalles de Claude Mythos —su modelo más avanzado— y anunció al mismo tiempo que no lo pondrá a disposición general.

El motivo: en pruebas internas, el modelo demostró una capacidad para explotar vulnerabilidades de software sin precedentes. En la generación de exploits para Firefox, Claude Opus 4.6 logró 2 ataques funcionales en cientos de intentos. Mythos logró 181.

En lugar de publicarlo, Anthropic creó el Proyecto Glasswing: un programa de acceso restringido a 12 empresas —entre ellas Amazon, Apple, Cisco, CrowdStrike, Google, Microsoft y NVIDIA— para usar Mythos específicamente en tareas de ciberseguridad defensiva. La compañía aporta 100 millones de dólares en créditos de uso y 4 millones en donaciones a organizaciones de seguridad de código abierto.

El dato que resume la escala del salto: “Mythos es a Opus lo que Opus es a Sonnet.” Por primera vez, un laboratorio ha desarrollado un modelo y tomado la decisión pública de no publicarlo. La decisión es tan significativa como el modelo en sí.

Ahora cualquiera puede desplegar agentes propios en la nube de Anthropic

Esta semana entró en beta pública Claude Managed Agents, el servicio de Anthropic que permite a cualquier desarrollador —o empresa— construir y desplegar agentes de IA directamente desde la consola de Claude, sin necesidad de gestionar la infraestructura. El funcionamiento: defines las tareas, herramientas y límites del agente; Anthropic se encarga del resto.

Entre los primeros casos en uso real: Notion está usando Managed Agents para construir una función de “delegar tarea a Claude” directamente desde su interfaz. Los agentes soportan sesiones largas, coordinación entre múltiples instancias y escenarios de producción real.

El cambio práctico es relevante: hasta ahora, construir un agente de IA que funcionara de forma fiable en producción requería un equipo técnico. Managed Agents no elimina la curva de decisión —qué delegar, cómo definir los límites, cómo verificar— pero sí elimina una parte importante de la barrera técnica para llegar ahí.

Meta volvió al mapa con un nuevo laboratorio y su primer modelo

Meta Superintelligence Labs, el nuevo laboratorio creado por Mark Zuckerberg y dirigido por Alexandr Wang —ex CEO de Scale AI— publicó esta semana su primer modelo: Muse Spark. Según la compañía, reconstruyeron toda la infraestructura de IA desde cero para desarrollarlo, incluyendo nuevas arquitecturas y pipelines de datos.

En benchmarks independientes, Muse Spark se sitúa entre Claude Sonnet 4.6 y Opus 4.6 — por debajo de los modelos líderes de Google, OpenAI y Anthropic, pero por delante de lo que Meta había publicado hasta ahora. El acceso vía API está confirmado para próximas semanas, y Zuckerberg ha prometido una versión de código abierto, aunque sin fecha concreta.

La mitad de los consumidores prefiere marcas que no usan IA en su contenido

Una encuesta de Gartner publicada esta semana midió algo que pocas empresas han querido cuantificar: cuántos consumidores tienen activamente preferencia por marcas que no usan inteligencia artificial generativa en su publicidad, mensajes o contenido. La respuesta: aproximadamente el 50%.

La cifra ha activado un segmento de mercado que no existía hace dos años. Aerie, Equinox, Almond Breeze y Polaroid han convertido el “sin IA” en estrategia de comunicación explícita. “Hecho por humanos” está tomando el mismo espacio que en su momento ocuparon “orgánico”, “sin OGM” o “artesanal”.

Gartner resume la lección con precisión: “los equipos de marketing deberían tratar GenAI como una decisión de confianza, no solo tecnológica.” El umbral no está donde muchas empresas asumen que está.

Google AI Overviews: el 10% de error son millones de respuestas falsas por hora

Un estudio del New York Times publicado esta semana analizó la tasa de precisión de los resúmenes generados por IA en las búsquedas de Google (los bloques que aparecen en la parte superior de los resultados antes de los enlaces). El resultado: aciertan aproximadamente el 90% de las veces.

El número parece razonable hasta que se calcula a la escala de Google. Con 5 billones de búsquedas al año y una tasa de error del 10%, las respuestas incorrectas se cuentan en decenas de millones por hora. Cada una de ellas aparece con el mismo formato, el mismo tono de autoridad y el mismo diseño visual que una respuesta correcta.

El estudio identificó tres fuentes principales de error: el uso de Facebook y Reddit como referencias (los puestos 2 y 4 en la jerarquía de fuentes del sistema), la citación de páginas que no respaldan la afirmación que se atribuye a ellas, y la generación de síntesis incorrectas de información factual. Ninguno de estos errores es visible para el usuario en el momento de recibir la respuesta.

Confianza visual y precisión real son dos variables distintas. Los sistemas de IA están optimizados para la primera.

Estas señales no se entienden mejor de forma aislada. En Amplify Premium trabajamos cómo leerlas juntas y qué posición estratégica tomar antes de que sean obvias para todo el mundo.

En profundidad:

La empresa que construye la automatización ya sabe lo que va a pasar

El lunes de esta semana, OpenAI publicó un documento de 13 páginas titulado Industrial Policy for the Intelligence Age.

Habría pasado relativamente desapercibido si no fuera por lo que propone: un impuesto sobre los sistemas automatizados equivalente al que pagarían los trabajadores humanos que reemplazan, un fondo de riqueza pública financiado en parte por las propias empresas de IA, pilotos obligatorios de una semana laboral de 32 horas sin reducción salarial, y mecanismos de activación automática para programas de asistencia social cuando la tasa de desplazamiento laboral por IA supere ciertos umbrales.

Lo notable no es el contenido de las propuestas. Lo notable es quién las hace.

OpenAI es la compañía que con mayor velocidad e inversión está construyendo los sistemas que automatizarán trabajo humano a escala. Que sea la misma compañía la que propone a los gobiernos cómo amortiguar el impacto de esa automatización no es una contradicción accidental. Es una señal de lo que esperan que ocurra.

Las empresas no elaboran propuestas de política pública sobre problemas que consideran hipotéticos. Lo hacen cuando el problema es suficientemente real y suficientemente próximo como para que la conversación pública sea inevitable. El timing —con OpenAI a meses de su posible salida a bolsa y con una valoración de 852.000 millones de dólares— añade una capa estratégica obvia: llegar primero al debate regulatorio es siempre mejor que reaccionar a él.

Pero más allá de la lectura cínica, el documento dice algo que merece tomarse en serio: los efectos de la automatización sobre el mercado de trabajo van a ser lo suficientemente severos como para requerir nuevas estructuras económicas. No reformas marginales. Eso no lo dice una ONG. Lo dice la compañía que lidera el proceso.

¿Qué implica esto para alguien que gestiona una empresa, una consultoría o un equipo de trabajo?

Primero: que el horizonte temporal es más corto de lo que muchos planifican. Las propuestas de política pública no se elaboran para efectos a veinte años. Se elaboran para efectos que se verán en el próximo ciclo electoral. OpenAI no está pensando en 2045. Está pensando en 2027 y 2028.

Segundo: que la pregunta relevante no es “¿me afectará la automatización?” sino “¿en qué lado de la ecuación estará mi negocio?” Hay negocios que se benefician directamente del desplazamiento de trabajo (porque lo automatizan, lo median, o lo facilitan). Hay negocios que necesitarán protección de él. La diferencia entre los dos no es una cuestión de tamaño o sector: es una cuestión de posicionamiento deliberado.

Tercero: que el mercado “hecho por humanos” —que ya representa la preferencia del 50% de los consumidores según el estudio de Gartner que vimos esta semana— es también una señal de la misma dinámica. La automatización crea su propio contramovimiento. Para algunos negocios, ese contramovimiento es la oportunidad.

Las propuestas de OpenAI pueden o no convertirse en política real. Pero el hecho de que existan, y de que vengan de quien vienen, es en sí mismo un dato que dice algo sobre lo que viene.

Herramienta de la semana

Canva Magic Layers

El problema que resuelve. Te llega un diseño —un cartel, un flyer de evento, una imagen de marketing— y necesitas cambiar la fecha, el precio o el texto. Pero no tienes el archivo original. Solo tienes la imagen plana. Hasta ahora, la única opción era rehacerlo desde cero o pedir el archivo a quien lo diseñó.

Qué es Canva Magic Layers. Una función dentro de Canva que analiza cualquier imagen que subas y la descompone automáticamente en capas editables: texto por un lado, objetos e ilustraciones por otro, fondo por otro. El sistema detecta los elementos visuales y los separa sin que tengas que hacer nada. Una vez procesado, puedes hacer clic en cualquier elemento — una fecha, un titular, un precio — y editarlo directamente.

Para quién es útil. Para cualquiera que trabaje con materiales visuales que recibe en formato imagen: consultores que adaptan materiales de sus clientes, equipos de marketing que actualizan campañas existentes, emprendedores que gestionan su propia comunicación sin equipo de diseño.

Pregunta de la semana

El estudio de Gartner dice que la mitad de los consumidores prefiere marcas que no usan IA en su contenido. No el 5%. No una minoría vocal en redes. La mitad.

Eso no significa que tu negocio deba abandonar las herramientas que ya usa. Significa que hay una decisión de posicionamiento que vale la pena tomar de forma consciente, no por defecto.

¿Sabes en qué lado está tu negocio? ¿Y lo sabes porque se lo has preguntado a tus clientes, o porque lo has asumido?

Nos leemos la semana que viene.

— El equipo de Amplify